上个礼拜,我在家写一个爬虫脚本,想着偷个懒让Claude帮忙写核心代码。结果呢?来回改了七八次,token烧掉好几美金不说,最让我崩溃的是——它生成的代码死活跑不起来,报错信息还得我自己复制粘贴去查。更要命的是,我把一整套API密钥和本地数据库结构全粘贴到网页端了,虽然大厂说数据保密,但这心里头总归是悬吊吊的,跟没穿裤子逛街似的。

这时候我才意识到,天天喊“AI赋能”,结果赋了个寂寞。真正干活的时候,浏览器里的那些大模型,就跟只会动嘴不会动手的“军师”一个样。

后来实在被整得没脾气了,我就去GitHub上瞎逛,结果发现个叫OpenClaw的项目最近火得一塌糊涂,狂揽十多万颗星-5。这玩意儿跟那种聊天AI不一样,它是真的能“动手”——能直接读写我硬盘里的文件、能自动跑命令行、甚至能帮我操作浏览器。这不就是我梦寐以求的“贾维斯”吗?

但问题来了,这玩意儿要本地部署。看看我那台老电脑,16GB内存,连个大点的模型都跑不起来。难道为了跑个Agent,我还得去组一台双路显卡的“电暖器”?直到我搞来一台搭载AMD锐龙AI Max+ 395的迷你工作站,才发现以前的我格局确实小了。

那一夜,我把128GB的内存喂给了AI

以前大家都迷信Mac搞AI,为啥?不就是因为苹果的统一内存架构,显存不够内存来凑嘛。但在X86这头,英伟达那帮显卡虽然算力猛,但显存墙卡得死死的。你哪怕扛回来一张RTX 5090,真跑起那种能把代码仓库整个吞下去的Agent,32GB显存也就是个起步价,多开几个任务直接爆给你看-2。

这也是为什么我这次会被AMD惊到。这代锐龙AI Max+ 395是真的不讲武德,直接在芯片里塞了40个RDNA 3.5计算单元,最关键的是,它支持最高128GB的统一内存-5。

我当时把那台abee AI Station 395 Max抱回家,第一件事就是装OpenClaw。在BIOS里把可变显存一开,直接划了96GB给GPU当显信用。那一刻的感觉怎么说呢?就像你以前用小水管接水,现在直接给你接上了三峡大坝。

我试着让本地部署的Qwen3-Coder帮我重构一个老项目,这货不仅把我那一堆屎山代码理顺了,还自动调用了Pygame库给我写了个赛博朋克风格的贪吃蛇,写完直接双击运行,全程丝滑得跟吃了德芙一样-2。看着游戏窗口弹出来的那一刻,我是真的有点恍惚——这不就是我初中时幻想的那种未来吗?

这种“AMD AI代理”的本地化体验,最爽的地方在于它不需要在云端和本地来回倒腾数据。以前用云端API,你每问一句“帮我看一下这个文件夹里的代码有什么问题”,它得先把文件列表传上去,分析完再把指令传回来,来来回回不仅慢,而且费钱。现在这老哥就住在我硬盘里,直接对着我的文件系统操作,那叫一个快准狠。

钱不钱的不说,关键是“裸奔”这事儿受不了

其实成本还是毕竟真干活的话,那点电费比起API调用费,简直跟不要钱一样。根据至顶网那帮硬核玩家的测试,长期跑OpenClaw这种重负载任务,本地部署的成本优势是指数级的-5。但对我来说,更敏感的是数据安全。

我之前让云端AI帮我写代码,得把整个项目的业务逻辑、数据库字段甚至是一些内网的API地址全喂给它。虽然现在大厂都说数据脱敏,但对于我们这种小作坊来说,核心代码就是命根子,真流出去了一两页,哭都没地方哭。

这也是为什么我觉得 AMD 这次的路子走对了。他们不仅在搞那种给极客玩的大模型,还在CES上跟Iterate.ai一起搞了个叫“Generate”的离线AI套件-4。这玩意儿说白了,就是把数据主权彻底还给用户。

我现在每天早上到公司,打开那个“金融经理”的代理卡片,它能直接读取我本地加密的Excel账单,自动帮我分析上个月的支出大头在哪,甚至能规划旅游预算-4。整个过程不需要联网,全在本地那颗XDNA 2架构的NPU里跑完,功耗低还不耽误我干别的活儿。

那种感觉就像是请了一个住家的私人管家,而不是那种把你家底儿全拿出去到处说的长舌妇。特别是处理那些涉及患者隐私或者财务数据的文档时,心里那块大石头总算是落地了。

别以为这是极客玩具,AMD这次是来真的

可能有人会觉得,这不还是折腾嘛,跟我普通人有啥关系?但你得看AMD最近这些动作,那绝对是要把这玩意儿往普通人桌面上推的架势。

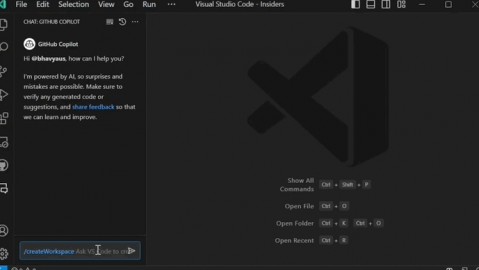

就前几天,他们那版Adrenalin 26.1.1驱动,直接搞了个“AI套装”,一键把PyTorch、Ollama、LM Studio这些以前搞死人环境变量的东西全给你打包装了-9。我虽然是个老鸟,但也记得当年配TensorFlow环境时那种想砸电脑的心情。现在AMD把这玩意儿集成到驱动里,意思很明确:不管你懂不懂代码,只要你用的是我的卡,你就能玩转本地AI。

更别提他们在企业级层面的布局了。苏姿丰亲自出来说,现在随着那种“代理式AI”应用的兴起,CPU的需求反而被低估了-1。因为很多Agent任务不仅仅是跑矩阵运算,更需要大量的逻辑判断和调度,这时候CPU的核心数和大缓存就派上用场了。

我还注意到,AMD投了2.5个亿跟Nutanix搞在一起,要建什么“开放的全栈AI基础设施平台”-3-7。这事儿看着离普通人远,其实意义大得很。这意味着以后企业在部署AI的时候,不用再被某一家厂商绑死,可以在自己的数据中心里,甚至是在边缘端,灵活地跑各种开源模型。这恰恰是AMD AI代理战略里最狠的一招——开放和不捆绑。

我现在就在等,等那帮OEM厂商把基于锐龙AI 400系列的笔记本铺货-8。想想看,以后随便一台轻薄本,自带50-60 TOPS的算力,插电不插电都能跑个百亿参数的模型帮你干活。这不比抱着个又厚又重的游戏本当“移动AI工作站”强多了?

说真的,折腾完这一圈,我最大的感受是:AI这玩意儿,只有捏在自己手里,才真的算个东西。你依赖云端一天,你就得忍受延迟、忍受隐私泄露的风险、忍受每个月的订阅账单。而AMD现在给的这条路,虽然折腾了点,但起码让我觉得,那个能24小时待命、绝对听话、永不泄密的“贾维斯”,真的不远了。

网友评论区:

网友“码农不秃头”问:

我就一写Java的后端,平时也就用Copilot补全一下代码,你吹的这个本地Agent对我这种小白来说是不是太折腾了?到底能干啥实际的事儿啊?

答:

兄弟,千万别觉得这是折腾!其实恰恰相反,AMD现在推的这些玩意儿,就是专门为了解决你这种“懒得折腾”的需求的。你想啊,你平时用Copilot,是不是还得手动复制粘贴代码,还得自己切回终端跑命令?

我给你举个我最近的真事。上周我接了个活儿,要把一个老项目的日志格式全部统一,还得统计一下最近一个月哪些API报错最多。以前我得干嘛?写脚本、grep日志、手动跑分析。那天我懒癌犯了,直接对着本地部署的OpenClaw吼了一句:“去把我桌面那个logs文件夹下所有带error的日志捞出来,按接口分组排个序,顺便生成一个柱状图放在桌面上”。

结果呢?这货自己调用Python脚本,遍历文件,分析数据,最后还真给我用matplotlib画了个图弹出来。全程我就坐在那喝了口咖啡,代码一行没写。这不比你在那敲半天shell命令香多了?而且因为全在本地跑,你那些涉及业务机密的日志根本不用上传,公司信息安全部都挑不出你毛病。所以说,这根本不是折腾,这是给自己请了个24小时加班的实习生,还不用给工资的那种。

网友“搞机实验室阿强”问:

你这文章看得我心痒痒,但我平时主要是用笔记本干活,笔记本散热压得住这玩意儿吗?会不会一跑AI风扇就起飞,跟开飞机似的?

答:

哈哈,你这问到点子上了!其实我之前也有这顾虑,总觉得搞AI就得台式机,笔记本那小身板扛不住。但你还真别说,AMD这次在能效比上确实有点东西。

你去看Windows Central那篇评测,他们测了新的锐龙AI PRO 400系列-8。这代移动端的NPU算力能干到50-60 TOPS,远远超过微软那个Copilot+ PC要求的40 TOPS及格线。关键是,这活儿是NPU干的,不是拿CPU和GPU硬刚。

我用那台abee的机器跑负载的时候留意过,跑本地Agent的时候,如果是那种持续的、轻量级的文件整理或者日程分析,风扇基本没啥动静。就算是跑那种复杂的代码生成,GPU利用率飙上去,那个散热系统也能压得住,毕竟人家用的是全覆盖液冷-2。笔记本的话,现在像铭凡出的那种Mini工作站,3.3L的体积都能稳住130W的性能释放-5。所以只要你选那种散热设计好一点的机器,根本不用担心起飞。反倒是笔记本自带大内存这事儿,比你担不担心散热重要多了。

网友“数据民工老王”问:

我是个搞金融数据分析的,最怕的就是数据泄露。公司明文规定不准把客户资料传云。这本地AI听起来挺美,但它够“聪明”吗?能处理那种复杂的Excel模型和PDF报表吗?

答:

哎哟喂,老王,你这工作性质简直就是为这种本地 AMD AI代理 量身定做的!你担心的这个问题,恰恰是AMD现在主打的核心卖点——“数据主权”。

我给你吃个定心丸。AMD官方博客里专门介绍过那个“Generate”套件,里面有个“金融经理”的角色-4。这东西厉害在哪儿呢?它完全离线工作,你可以直接把你那些带着客户代码、身份证号的加密Excel或者PDF丢给它。

你给它下指令,比如“把今年Q3所有收益率低于基准的产品筛出来,顺便分析一下这些产品共同持仓的重仓股是哪些”。它就能在你断网的电脑里,把这些事全干了。因为它用的是本地的RAG(检索增强生成)技术,先把你的文档向量化存在本地,然后在这个私有的知识库里找答案-4。

这就完美解决了你那个既要利用AI干活,又怕数据出门的痛点。其实现在很多银行和券商都在盯着这个方向,这也是为什么AMD要砸钱跟Nutanix合作搞企业级平台,就是为了给这些行业一个能放在自己机房里、完全可控的AI方案-10。对你个人而言,这就意味着你可以光明正大地用AI处理敏感数据,再也不用偷偷摸摸地脱敏或者担心被开除了。