AI正在重新定义创作边界,而“AI助手海报”正是这一浪潮中最具实用价值的能力之一。想象一下:你对着AI说一句“生成一张春季新品发布的海报”,它不仅能理解你的意图,还能自动联网检索最新趋势、调用设计模型、生成符合品牌调性的视觉作品。这背后究竟是什么技术在支撑?本文将从痛点切入,系统拆解AI助手实现“+海报生成”的核心技术链路——涵盖RAG(检索增强生成)、智能体工具调用、多模态生成等关键知识点,辅以代码示例和高频面试题,帮助你在理解原理的同时,掌握面试考点。

一、痛点切入:传统海报设计的困境

在设计一张商业海报之前,设计师通常要经历以下流程:

传统海报设计流程(伪代码)def traditional_poster_design(idea): 步骤1:手动搜集灵感素材 trends = manual_search("设计趋势 2026") references = manual_search("竞品海报") 步骤2:打开设计工具,手动构图 canvas = create_canvas() 步骤3:逐个添加元素 for element in idea["elements"]: asset = find_or_draw_asset(element) 耗时最长 canvas.place(asset) 步骤4:反复修改调优 while not client_satisfied: canvas.modify_based_on_feedback() return canvas.export()

这种传统模式存在三大痛点:

信息搜集效率低:灵感素材需要手动检索、筛选、整理,热点借势的时机往往在素材到位前就已错过。

设计与检索割裂:灵感素材和设计工具是两个独立的系统,无法实时联动。

修改成本高:改一个字、调一个颜色,都可能需要重新走完整套流程。

据某行业调研,超过65%的企业在实施智能时面临知识时效性瓶颈和垂直领域适配难题,传统系统在处理复杂业务场景时暴露出明显的局限性-6。这促使技术演进向检索增强生成(RAG,Retrieval-Augmented Generation) 和智能体(Agent) 架构方向突破。

二、核心概念讲解:RAG(检索增强生成)

RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索与生成模型相结合的技术框架,旨在解决大语言模型知识时效性不足和“幻觉”问题。

用生活化类比来理解:想象你在准备一场考试。传统LLM相当于一个“闭卷考试”——只能依靠记忆中的知识回答。而RAG相当于给了你一个“可以随时翻阅的资料库”——遇到不会的问题,先去资料库查找相关信息,再结合查到的内容作答。

RAG的核心工作流分为三个阶段:

检索阶段:将用户查询转换为向量,在海量知识库中进行相似度匹配,召回相关文档。

增强阶段:将检索到的文档作为上下文与原始查询拼接,形成增强后的提示词。

生成阶段:LLM基于增强后的提示词生成最终答案。

这一架构通过分离检索与生成阶段,在保证回答准确性的同时降低计算资源消耗-6。对于“AI助手海报”场景而言,RAG让AI能够实时检索最新的设计趋势、品牌规范和行业资讯,而非仅依赖训练数据中的“过时知识”。

三、关联概念讲解:智能体(Agent)与工具调用

如果说RAG回答了“AI怎么获取外部知识”的问题,那么智能体(Agent) 则回答了“AI怎么执行外部动作”的问题。

智能体是一种能够自主感知环境、做出决策并执行动作的AI系统。在大模型语境下,Agent通过工具调用(Tool Calling / Function Calling) 机制来实现对外部系统的操作。

工具调用的核心三要素包括:执行逻辑(定义输入输出规范)、元数据描述(自然语言标注工具功能)、参数约束(明确数据类型与必填项)-5。

RAG与Agent的关系可以这样概括:RAG是“怎么找”,Agent是“怎么做”。

| 维度 | RAG | Agent |

|---|---|---|

| 核心问题 | 如何获取外部知识 | 如何执行外部操作 |

| 输入输出 | 查询 → 文档 | 查询 → 动作 |

| 典型组件 | 向量检索 + 生成模型 | 规划器 + 执行器 + 工具集 |

| 实现方式 | 检索 → 增强 → 生成 | 规划 → 调用 → 反馈 → 迭代 |

用一句话高度概括:RAG解决的是“知道什么”,Agent解决的是“能做什么”。 在“AI助手海报”场景中,两者协同工作——RAG负责检索最新的海报设计趋势和品牌规范,Agent负责调用图像生成模型、排版工具和API接口来实际创作海报。

四、代码示例:一个简化的“AI助手海报”实现

以下代码展示了一个极简的实现框架,突出RAG+Agent的核心逻辑:

简化版:AI助手海报核心流程 import json class PosterAgent: def __init__(self, llm, retriever, tools): self.llm = llm 大语言模型 self.retriever = retriever RAG检索器 self.tools = tools 可用工具集(生图、排版、检索等) def generate_poster(self, user_request): 阶段1:意图理解 + 检索增强 context = self.retriever.search(user_request) 检索结果包含:品牌规范、设计趋势、参考案例 阶段2:规划工具调用序列 plan = self.llm.plan_tools( request=user_request, context=context, available_tools=list(self.tools.keys()) ) 典型规划:["search_trends", "generate_image", "apply_layout"] 阶段3:执行工具调用 intermediate_result = {} for tool_name, tool_params in plan["steps"]: result = self.tools[tool_name].execute(tool_params) intermediate_result[tool_name] = result 阶段4:最终生成 final_poster = self.llm.generate( f"基于以下素材生成最终海报:{intermediate_result}" ) return final_poster 使用示例 agent = PosterAgent(llm=my_llm, retriever=my_retriever, tools=my_tools) poster = agent.generate_poster("生成一张春季数码产品发布海报,现代简约风格")

关键点标注:

retriever.search():RAG的核心,从知识库中检索相关信息plan_tools():Agent的规划能力,决定调用哪些工具及其顺序这种架构实现了“→规划→执行→生成”的完整闭环

对比传统方式:传统需要设计师手动素材→打开设计软件→逐个元素绘制→反复修改;而Agent方案实现了端到端的自动化,让AI独立完成从资料搜集到海报生成的完整工作流-。

五、底层原理支撑

“AI助手海报”的能力并非凭空而来,它建立在以下技术基础之上:

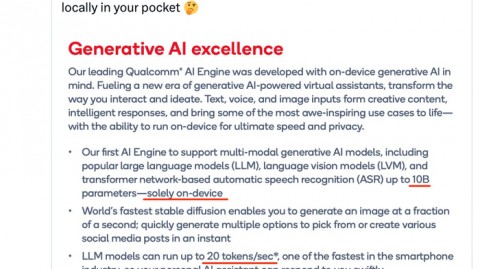

向量检索与语义匹配:将文本和图像映射到同一向量空间,实现跨模态的相似度计算。硬件加速向量检索可将复杂查询处理延迟降低至50ms以内-6。

扩散模型(Diffusion Models) :当前主流图像生成(如Stable Diffusion、DALL-E)的底层技术。通过从纯噪声逐步“去噪”生成图像,实现对文字指令的高保真还原。最新的Latent Forcing方法通过调整生成顺序(先定结构、后填细节),在保持像素级精度的同时显著提升图像质量-21。

多模态大模型:同时处理文本、图像、视频等多种模态数据的能力。2026年1月,商汤开源的多模态自主推理模型SenseNova-MARS(8B和32B版本)在多模态与推理基准测试中以69.74的平均得分超越了Gemini-3-Pro和GPT-5.2,成为首个同时支持动态视觉推理和文本/图像的开源Agentic VLM-31。

理解这些底层原理,有助于你在优化“AI助手海报”系统时做出更合理的技术选型,而非盲目堆砌工具。

六、高频面试题与参考答案

Q1:RAG和微调(Fine-tuning)有什么区别?分别在什么场景下使用?

踩分点:先讲定义差异,再讲场景区分。

参考答案:

定义差异:微调是在预训练模型基础上,使用特定任务数据进行参数更新,改变模型本身的知识分布;RAG不修改模型参数,仅通过检索外部知识库来增强回答。

使用场景:

微调适合知识结构稳定、需要模型内化的场景(如特定领域术语、公司内部规范)

RAG适合知识频繁更新、需要实时获取的场景(如新闻热点、商品库存、设计趋势)

实际生产中常用两者结合:用微调让模型掌握基础能力,用RAG补充时效性信息

Q2:在Agent系统中,如何解决多工具调用的协调问题?

踩分点:强调规划机制和依赖管理。

参考答案:

核心挑战在于任务分解和依赖关系管理。当前主流方案采用DAG(有向无环图,Directed Acyclic Graph) 建模工具调用关系,通过任务规划器将复杂指令分解为可并行执行的子任务。例如,TURA框架中的DAG-based Task Planner能够建模任务依赖关系,实现最优并行执行,在服务于千万级用户的工业系统中满足低延迟需求-1。

Q3:大语言模型的“幻觉”问题是什么?RAG如何缓解这一现象?

踩分点:先解释幻觉的定义,再说明RAG的缓解机制。

参考答案:

定义:幻觉是指LLM生成与事实不符、无依据或自相矛盾的内容,是当前大模型应用的核心风险之一。

缓解机制:RAG通过强制模型基于检索到的证据作答,显著降低凭空捏造的概率。具体包括:

在提示词中明确要求模型优先使用检索内容

限制模型的自由生成空间

通过引用机制让模型输出可追溯的证据来源

Q4:什么是向量检索?它在RAG中扮演什么角色?

踩分点:先讲定义,再讲作用和关键技术。

参考答案:

定义:向量检索是将文本、图像等数据转换为高维向量,通过计算向量间的距离(如余弦相似度)来找到语义相似内容的技术。

作用:在RAG中,向量检索负责从知识库中快速召回与用户查询相关的文档,是决定RAG效果的关键环节。

关键技术:ANN(近似最近邻,Approximate Nearest Neighbor)算法实现毫秒级响应,支持十亿级数据规模;混合精度量化可将内存占用降低75%的同时保持98%以上的精度-6。

七、结尾总结

回顾全文,我们围绕“AI助手海报”这一能力,从三个递进层次完成了知识梳理:

概念层:区分了RAG(检索增强生成,解决“知识获取”)与Agent(智能体,解决“动作执行”)的逻辑关系——RAG回答“知道什么”,Agent回答“能做什么”。

实现层:通过简化的代码示例展示了RAG+Agent的协同工作流程,并揭示了底层依赖的向量检索、扩散模型、多模态大模型等核心技术。

考点层:提炼了4道高频面试题,涵盖RAG vs 微调、多工具协调、幻觉缓解、向量检索等核心考点。

重点提示:在面试中,务必清晰区分RAG和Agent的角色,并用一句话概括——RAG是“资料库”,Agent是“工具箱”,两者共同构成AI助手的“大脑”与“双手”。关于多模态生成、扩散模型底层原理等进阶内容,敬请关注本系列下一篇深度解析。