北京·2026年4月10日

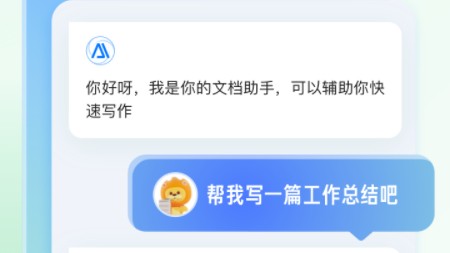

随着大语言模型技术的快速迭代,AI写作助手已从概念性产品演变为日常生产力工具。本文将从技术原理出发,系统讲解AI写作助手的核心机制,包含概念解析、代码示例、底层原理与高频面试题,帮助读者建立完整知识链路。

一、为什么需要AI写作助手:痛点切入

在AI写作助手出现之前,内容创作主要依赖传统实现方式:

传统模板式生成 def generate_article(template, keywords): result = template.replace("{keyword1}", keywords[0]) result = result.replace("{keyword2}", keywords[1]) return result 使用示例 template = "今天我们聊聊{keyword1}和{keyword2}..." article = generate_article(template, ["AI写作助手", "大语言模型"])

这种模板生成方式的痛点非常明显:

缺乏灵活性:只能产出固定格式内容,无法应对多样化写作需求

语义不连贯:关键词替换往往破坏语句的自然流畅性

扩展成本高:每新增一种内容类型,都需要重新编写模板

无法理解上下文:不能根据前文自动调整后文的语气和风格

正是为了解决这些问题,AI写作助手应运而生。它不再依赖预定义模板,而是通过在大规模文本数据上训练的深度学习模型,自主理解和生成自然语言。

二、核心概念讲解:大语言模型(LLM)

2.1 标准定义

LLM(Large Language Model,大语言模型) 是指在海量文本数据上训练出来的概率计算系统。其核心任务是接收输入文本序列,预测下一个最可能出现的词(即Next Token Prediction)-60。

2.2 通俗类比

想象一个语言学习游戏:AI阅读了全网数十亿篇文章后,学会了一个本领——当你给它上半句,它能接出下半句。比如你输入“今天天气真好,我想去”,AI会基于训练中学到的统计规律,在“公园”“散步”“郊游”等候选词中选出概率最高的进行输出-44。

2.3 关键价值

AI写作助手的核心价值在于将这种预测能力规模化、产品化,让非技术人员也能通过自然交互完成高质量写作。根据行业数据,预计2026年全球AI创新写作助理市场规模将达到26.7亿美元,复合年增长率21.4%,反映了市场对这一技术的广泛认可-1。

三、关联概念讲解:生成式预训练转换器(GPT)

3.1 标准定义

GPT(Generative Pre-trained Transformer,生成式预训练转换器) 是由OpenAI提出的一类基于Transformer架构的自回归语言模型-44。其训练分为两个核心阶段:先在无标注的海量数据上进行预训练,再通过少量标注数据进行有监督微调。

3.2 GPT与LLM的关系

可以用一句话概括:LLM是一个技术类别,GPT是该类别中最具代表性的模型家族。类比“汽车”与“特斯拉”——前者是统称,后者是具体品牌和实现。

3.3 GPT的生成机制

GPT的文本生成基于两步流程:

第一步:无监督预训练。AI在海量文本上学习“文字接龙”。例如输入“花谢花飞花满”,模型预测最可能是“花满天”“花满地”还是“花满园”。由于每种说法都合理,GPT每次输出的结果会有所不同-44。

第二步:人类引导优化。为了让GPT给出更有用、更符合人类期望的回答,研究人员会让人类对模型的输出进行打分和筛选,引导模型往人类期望的方向生成内容-44。

3.4 Transformer架构与自注意力机制

GPT的底层架构基于Transformer。Transformer是一种完全基于注意力机制(Attention Mechanism)的神经网络架构,在2017年谷歌发表的论文《Attention Is All You Need》中首次提出,自此成为几乎所有大语言模型的基石-29。

自注意力机制是Transformer的核心思想。它通过三个关键矩阵实现:查询矩阵(Query)、键矩阵(Key)、值矩阵(Value)。模型对序列中的每个位置计算与其他所有位置的关联度,从而捕捉长距离依赖关系-29。

通俗理解:想象你在会议室开会,自注意力机制让你能同时关注所有说话人的发言,而不是只能听到前一个人说了什么。这样,当会议进行到第10分钟时,你仍然记得第1分钟提到的关键信息-。

传统的RNN(循环神经网络)需要按顺序处理序列,距离越远的信息记忆越模糊;而Transformer通过自注意力机制,让序列中的每个元素都能与所有其他元素直接建立关联,极大提升了模型对上下文的理解能力。

四、概念关系与区别总结

| 维度 | LLM(大语言模型) | GPT(生成式预训练转换器) |

|---|---|---|

| 定义范围 | 技术类别,泛指大规模语言模型 | 具体模型家族,LLM的一种实现 |

| 核心思想 | 基于海量数据训练的语言模型 | 生成式+预训练+Transformer架构 |

| 代表模型 | GPT、LLaMA、PaLM、DeepSeek等 | GPT-1到GPT-4系列 |

| 开源程度 | 既有开源也有闭源 | OpenAI闭源,但技术原理公开 |

一句话记忆:LLM是大语言模型的总称,GPT是LLM家族中采用Transformer架构的代表性实现。

五、代码示例演示

以下是用OpenAI GPT API调用AI写作助手的极简示例:

import openai 配置API密钥 openai.api_key = "your-api-key" def ai_writing_assistant(prompt, max_tokens=500): """ AI写作助手核心调用函数 """ response = openai.ChatCompletion.create( model="gpt-4", messages=[ {"role": "system", "content": "你是一位专业的写作助手,擅长各类文案创作。"}, {"role": "user", "content": prompt} ], temperature=0.7, 控制创造性(0~1之间) max_tokens=max_tokens 限制输出长度 ) return response.choices[0].message.content 调用示例 result = ai_writing_assistant("请写一篇关于AI写作助手的简短介绍") print(result)

执行流程解释:

输入编码:用户输入的Prompt(提示词)被编码为token序列

上下文理解:模型通过Transformer的自注意力机制,理解输入中的关键信息

逐词生成:模型基于已生成的文本和原始输入,不断预测下一个最可能的token

输出解码:生成的token序列被解码回自然语言文本返回给用户

六、底层原理与训练流程

6.1 预训练:让AI“博览群书”

预训练是AI大语言模型最基础、最关键的一步。研究人员给AI提供海量文本资料,包括教科书、学术论文、百科资料、代码和高质量网页内容等-57。

训练方式极其直观——让AI反复做“完形填空”或“文字接龙”游戏,通过预测下一个最可能出现的词来自我学习语言的规律。时间久了,AI就学会了语法结构、词语搭配、上下文关系,甚至顺带学会了事实常识-57。

6.2 微调:从“通才”到“专才”

经过预训练的AI已经是一个知识面广的“通才”,但可能在某些专业领域表现不够精准。微调就是用少量高质量的标注数据,让模型进一步学习特定领域的知识-58。例如用医学教材和病例数据微调,可以让通用模型变身医疗问答助手-57。

6.3 对齐优化:学会“如何说话”

仅仅有知识还不够。研究人员会通过RLHF(Reinforcement Learning from Human Feedback,人类反馈强化学习)技术,让模型学习更符合人类偏好的表达方式-57。这也解释了为什么同一个AI写作助手,在不同产品中的“语气”和“风格”可以天差地别。

6.4 推理应用:实际提供服务

当用户向AI写作助手提问时,模型进入推理阶段——不再学习,而是利用已经训练好的参数进行实时计算,一步步生成完整回答-57。

七、AI写作效果评估方法

如何衡量一个AI写作助手“写得好不好”?学术界和工业界常用的评估方法包括:

| 评估指标 | 衡量内容 | 简要说明 |

|---|---|---|

| BLEU | 词汇重叠度 | 计算生成文本与参考文本之间的n-gram重叠程度,值越高表示越相似- |

| ROUGE | 召回导向 | 强调生成文本覆盖了多少参考文本中的信息,常用于自动摘要评估- |

| Perplexity | 语言建模能力 | 衡量模型对测试数据的“困惑度”,数值越低表示模型对语言规律的拟合越好- |

| 人工评估 | 综合质量 | 由人类专家从流畅度、逻辑性、事实准确性等维度打分,目前仍是不可或缺的评估手段- |

实践提醒:BLEU和ROUGE值高并不代表回答一定好——它们不评估事实正确性、逻辑结构和上下文恰当性。科学的评估需要“自动指标+人工评估”相结合-。

八、高频面试题与参考答案

Q1:请简述LLM(大语言模型)的基本工作原理。

LLM是一个在海量文本数据上训练的概率计算系统,其核心任务是Next Token Prediction——给定上文后预测下一个最可能出现的词。它基于Transformer架构,通过预训练、微调和对齐优化三个阶段实现从“通才”到“专才”的转变。回答时可突出三个层次:概率预测机制、Transformer自注意力、三阶段训练。

Q2:Transformer模型中的自注意力机制(Self-Attention)是什么?为什么重要?

自注意力机制是Transformer的核心,它通过计算输入序列中每个元素与其他所有元素的关联度,捕捉长距离依赖关系。具体通过Query、Key、Value三个矩阵实现。它替代了RNN的循环结构,使模型可以并行计算,极大提升了训练效率和上下文理解能力。回答时应先概括定义,再说明三个矩阵的作用,最后强调其替代RNN的意义。

Q3:GPT模型的“预训练+微调”范式是什么意思?

预训练指在海量无标注数据上让AI完成“文字接龙”任务,学习语言通用规律,成本高但决定了能力上限;微调指用少量高质量标注数据对预训练模型进行定向优化,使其适配特定领域任务。回答时可以“基础教育+专业培训”的类比帮助理解,让面试官快速建立认知。

Q4:如何评估AI写作助手的生成质量?

通常结合自动指标和人工评估。自动指标包括:BLEU(衡量词汇重叠度)、ROUGE(衡量召回导向的覆盖程度)、Perplexity(衡量语言建模能力)。但自动指标存在局限性——可能给出高分却逻辑混乱,因此必须辅以人工评估,从流畅度、事实准确性、逻辑连贯性等维度综合判断。回答时可以先列出指标,再指出自动指标的局限性。

九、总结

本文系统梳理了AI写作助手的技术原理,涵盖以下几个核心知识点:

LLM是大语言模型的总称,核心机制是Next Token Prediction(下一个词预测)

GPT是LLM的代表性实现,基于Transformer架构,采用“预训练+微调”范式

Transformer的核心是自注意力机制,通过Query-Key-Value矩阵实现长距离依赖建模

训练分为四个阶段:预训练(筑基)、微调(专精)、对齐优化(规范)、推理应用(服务)

评估需结合BLEU/ROUGE等自动指标与人工评估,不可偏废

AI写作助手的发展正在加速,从代码补全到全流程自动化,底层原理的理解是进阶应用的基础。建议读者结合本文示例代码动手实践,尝试调用API并观察不同参数对生成结果的影响。

进阶预告:下一篇将深入探讨AI写作助手的上下文窗口扩展技术,以及多模态写作助手的实现原理,敬请期待。