更新时间:北京时间 2026年4月10日

AI助手识别目录深度解析:从概念到文件系统范式

AI助手识别目录是2026年AI工程化领域最热门的技术方向之一,其核心是将AI Agent的上下文管理从传统的代码层面迁移到文件系统层面,让AI像人类操作电脑一样,通过浏览目录结构来识别、组织和获取所需信息。这项技术正处于爆发前夜——字节火山开源的OpenViking项目已在GitHub收获21.7k Stars-3;Anthropic已将MCP协议捐赠给Linux基金会确立为行业标准-32;LlamaIndex的基准测试显示文件系统Agent在答案正确性上比传统RAG高出2分(8.4 vs 6.4)-14。大量开发者仍停留在“会用工具”的阶段:只知道给AI加MCP工具,却不懂目录如何驱动AI思考;知道RAG能检索,却讲不清为何文件遍历比向量检索更准确。本文将系统拆解AI助手识别目录的核心原理、技术演进路径、代码实现及高频面试考点,帮助你在这一轮技术浪潮中抢占先机。

一、痛点切入:为什么AI需要识别目录?

在2026年的AI工程实践中,一个根本性矛盾日益尖锐:大模型渴望海量上下文,但上下文窗口有限、Token费用高昂。来看一个典型的“笨办法”场景:

❌ 传统做法:把整个代码库塞进上下文 def naive_approach(): context = "" for file in os.listdir("./project"): with open(file, "r") as f: context += f.read() 加载整个文件 return llm.chat(context) Token爆炸!费用飙升!

这段代码暴露了三个致命缺陷:

耦合过高:AI Agent直接依赖具体的文件读取逻辑,换了存储介质(本地→云盘→数据库)就要重写代码。不同运行环境对文件系统的访问方式差异巨大——本地开发环境直接操作本机磁盘,云端沙箱需要通过远程API访问,测试环境则需要内存级模拟文件系统-10。

扩展性差:每增加一种上下文来源(代码仓库、文档、聊天记录、用户偏好),都要修改核心逻辑。OpenViking的开发者指出,大部分智能体的“记忆散落在代码里,资源塞在向量数据库,技能东一个西一个”,任务一长,上下文就爆炸,Token费用像坐火箭-3。

维护困难:调试时根本看不清AI用了哪些信息,智能体也无法学会真正成长。

这些问题催生了2026年AI工程领域最核心的设计范式转变——将文件系统作为AI与上下文交互的统一接口。

二、核心概念:AI助手识别目录

标准定义:AI助手识别目录(AI Assistant Directory Recognition)是指AI Agent通过解析、遍历和文件系统目录结构,自主发现和获取任务所需上下文信息的能力。在2026年的技术语境下,这一概念已从简单的“读取文件”进化为完整的“目录驱动型Agent架构”。

关键词拆解:

识别(Recognition):AI需要理解目录的语义——

docs/存文档,src/存代码,.git/存版本信息,而非将其视为无差别的一堆文件夹。目录(Directory):既是物理存储结构,也是逻辑工作流的编排器。ICM方法用编号文件夹代表阶段,用纯Markdown文件承载提示词和上下文,告诉单个AI Agent在每个步骤扮演什么角色-1。

上下文(Context):包括记忆、资源、技能三大类,通过文件系统统一管理,实现分层上下文加载和目录递归检索-3。

类比理解:想象你是一位AI新员工第一天入职。公司有两种安排方式:

❌ 传统RAG方式:HR把所有文档(员工手册、代码规范、会议纪要、历史邮件)堆在你桌上,说“自己翻”,结果你被信息淹没。

✅ 目录识别方式:IT先给你一个清晰的文件夹——

/current_tasks/(今日待办)、/knowledge_base/(知识库,按/team/、/project/分类)、/tools/(可用工具清单)。你只需ls看一眼目录结构,就知道去哪里找什么,按需cd和cat,高效且不迷茫。

这正是2026年顶级AI平台的做法:Cursor允许用户授权Claude访问特定文件夹-;OpenViking通过viking://协议给每个信息赋予唯一URI-3。

三、关联概念:MCP与上下文管理

MCP(Model Context Protocol,模型上下文协议)

定义:MCP是一个开放标准,让AI助手(Claude、ChatGPT、Gemini等)能够顺畅地与外部世界对话-32。它常被类比为 “USB-C for AI” ,解决了此前“每个AI应用连接每个外部服务都需要定制开发”的N×M集成复杂度问题-32。

核心能力:MCP采用客户端-服务器架构,提供三种能力——Resources(资源,向AI注入外部信息)、Tools(工具,AI根据上下文触发外部操作)、Prompts(提示模板,提供可重用指令)-32。

二者的逻辑关系

一句话概括:目录识别是“思想”,MCP是“工具”;文件系统是“画板”,AI是“画家”。

| 维度 | AI助手识别目录 | MCP |

|---|---|---|

| 定位 | 思维范式 / 架构理念 | 实现协议 / 通信标准 |

| 核心关注 | AI如何理解目录结构、按需加载上下文 | AI如何与外部工具/数据源通信 |

| 解决问题 | Token浪费、信息过载、上下文爆炸 | 集成复杂度、异构系统互联 |

| 典型实现 | ICM、OpenViking、Cursor动态上下文发现 | MCP Server/Client、Filesystem MCP |

更精确地说:MCP定义了AI如何发现和调用工具(通过.well-known/mcp.json端点自动发现服务器-);而目录识别定义了AI如何理解和使用文件系统这一最基础的“工具”。Cursor的做法是将工具输出转换为文件、将聊天历史存入文件、选择性加载MCP工具(减少46.9% Token)-2——这正是二者结合的最佳实践。

四、概念关系与区别总结

逻辑层次:

思想层面 → AI助手识别目录(以目录作为Agent架构的核心抽象) 实现层面 → MCP(标准化的通信协议)+ 文件系统接口(ls、cat、grep等) 工程落地 → OpenViking、Cursor、ICM等框架

记忆口诀:“目录即架构,文件即上下文,MCP即通道” 。

目录即架构:用文件夹的层级结构编排Agent的工作流程

文件即上下文:每个文件(.md、.txt、日志、代码)都是AI可读可写的信息单元

MCP即通道:AI通过M协议发现和调用目录背后的工具和能力

2026年的一个关键趋势是:文件系统正在取代RAG成为Agent上下文管理的核心抽象。LlamaIndex的基准测试显示,文件系统Agent在答案正确性上领先传统RAG 2分,验证了“让LLM访问它能用bash搞定答案的环境,比硬塞嵌入更有效”-14-20。

五、代码示例:实现目录识别式Agent

以OpenViking的“文件系统范式”为例,展示核心实现逻辑:

✅ 2026年推荐做法:目录驱动型Agent from openviking import VikingFS 字节火山开源项目 from filesystem_backend import Backend Eino ADK 抽象接口 class DirectoryAwareAgent: def __init__(self): 将上下文(记忆、资源、技能)映射为虚拟文件系统 self.vfs = VikingFS() 支持分层上下文加载 使用统一文件系统后端接口 Backend提供了LsInfo、Read、GrepRaw、GlobInfo等标准操作[reference:17] self.backend = Backend( base_path="/agent_context", memory_limit="10GB" 预算感知型管理[reference:18] ) def solve_task(self, user_query): Step 1: AI主动浏览目录结构,识别可用资源 directories = self.backend.LsInfo("/") 相当于ls / 输出: ["/resources/", "/memory/", "/skills/"] Step 2: 根据任务需求按需加载 if "代码问题" in user_query: code_files = self.backend.GrepRaw( pattern=user_query, path="/resources/code_repo/" ) 相当于grep -r Step 3: 不加载全量,只读必要部分 relevant_section = self.backend.Read( path="/resources/docs/api.md", offset=100, 从第100行开始 limit=50 只读50行 ) Step 4: 工具调用结果写回文件,不占上下文窗口 intermediate_result = tool_call(query) self.backend.Write("/temp/intermediate.json", intermediate_result) return llm.generate(user_query, context=relevant_section)

执行流程解析:

目录遍历:Agent调用

LsInfo()像人用ls命令一样,先“看”目录结构,而非盲目加载所有文件。按需检索:通过

GrepRaw()实现目录递归检索,只命中相关文件。分页读取:

Read(offset, limit)支持按行分页,解决大文件Token爆炸问题-10。结果卸载:将大型工具输出写入文件,Cursor通过这种方式将MCP工具相关的Token减少了46.9%-2。

六、底层原理支撑

目录识别技术之所以能在2026年爆发,依赖三个底层能力:

1. 文件系统抽象层

AI Agent在不同运行环境(本地磁盘、云端沙箱、内存模拟、OSS对象存储)中对文件系统的访问方式差异巨大-10。Eino ADK抽象出统一的Backend接口,解耦存储与业务逻辑,让Agent可以在切换环境时无需修改代码。

2. 预算感知型上下文管理

2026年AAAI等顶会的研究表明,简单的扩大上下文窗口反而导致性能下降-。BACM(Budget-Aware Context Management)将上下文管理建模为受预算约束的序列决策问题,让Agent自主决定“何时压缩”“压缩多少”-46。

3. 模型原生文件操作能力

现代大模型(Claude 4、GPT-5、Qwen-3等)在训练阶段已接触海量代码和命令行交互数据,天然理解ls、cd、grep等Unix语义-12。这让AI可以直接“理解”目录结构,而非依赖额外的解析层。

七、高频面试题与参考答案

Q1:AI Agent为什么需要识别目录结构?传统RAG有什么问题?

✅ 标准答案(踩分点:问题认知 + 对比分析 + 量化数据):

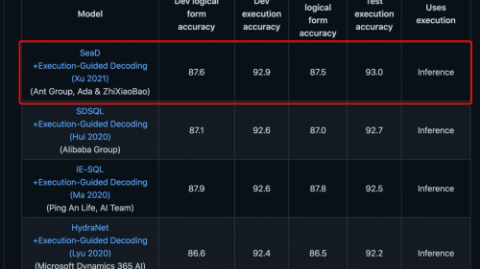

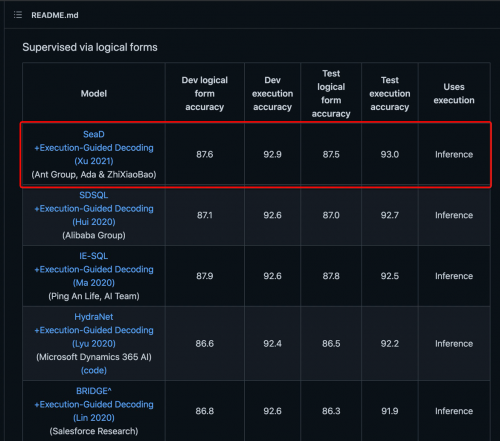

传统RAG存在三大问题:一是碎片化存储,记忆散落在向量数据库,无法体现信息间的层级关系-3;二是Token浪费,需要将大量无关片段塞入上下文窗口;三是调试困难,无法追溯AI用到了哪些信息。而文件系统范式通过分层目录、按需加载解决了这些问题。LlamaIndex 2026年的基准测试显示,文件系统Agent在答案正确性上比RAG高2分(8.4 vs 6.4)-14。

Q2:MCP和目录识别是什么关系?

✅ 标准答案(踩分点:层次定位 + 类比解释):

MCP是AI连接外部工具的标准化通信协议,提供Resources(资源)、Tools(工具)、Prompts(提示)三种能力-32。目录识别是一种架构思想——将文件系统作为AI与上下文交互的核心抽象,用目录层级编排工作流-1。二者是互补关系:MCP解决“如何连接”,目录识别解决“如何理解和使用”。Cursor的做法是最佳范例——将MCP工具输出写入文件,减少了46.9% 的上下文Token占用-2。

Q3:如何处理超长对话上下文?

✅ 标准答案(踩分点:多种策略 + 技术对比):

核心策略有五种:①文件卸载:将大型对话历史写入文件,按需读取-20;②摘要压缩:调用外部工具将交互历史凝练为紧凑摘要,如ReSum方法可将Agent性能提升4.5%-49;③预算感知管理:让Agent在剩余预算不足时主动压缩历史-46;④递归上下文扩展:MIT提出的RLM方法让模型在不改架构的情况下处理千万级token-;⑤任务拆解:长任务拆为子任务,每步只保留关键上下文-35。

Q4:文件系统Backend接口的核心方法有哪些?设计目标是什么?

✅ 标准答案(踩分点:接口理解 + 设计思想):

核心方法包括LsInfo(列目录)、Read(按行分页读取)、GrepRaw(正则)、Write(写入)、Edit(编辑替换)-10。设计目标是解耦存储与业务:同一Agent可在本地磁盘、云端沙箱、内存模拟等环境中无缝运行,无需修改业务代码。扩展接口还支持Execute同步命令执行和ExecuteStreaming流式命令执行,适用于长时间运行的任务。

Q5:如何评估Agent上下文管理的效果?

✅ 标准答案(踩分点:评估维度 + 方法论):

主要看三个维度:①任务成功率——用户诉求是否达成;②效率指标——平均步数、耗时、Token消耗;③工具调用准确率——选对工具且参数正确-35。离线阶段构建测试用例集,人工标注答案后用GPT-4辅助评分;上线后监控失败率、用户反馈,配合A/B测试迭代。LlamaIndex的评测方法值得参考:在5篇arXiv论文上构建问答对,同时测试RAG和文件系统Agent的准确性与响应速度-14。

八、总结回顾

本文系统梳理了2026年AI助手识别目录的核心概念与技术体系:

| 知识点 | 要点回顾 |

|---|---|

| 为什么需要 | 传统RAG碎片化存储、Token浪费、不可解释 |

| 核心概念 | AI通过目录结构自主发现和组织上下文 |

| 关联技术 | MCP(通信协议)+ 文件系统Backend(统一接口) |

| 记忆口诀 | 目录即架构,文件即上下文,MCP即通道 |

| 2026趋势 | 文件系统范式正在取代RAG成为主流,正确性领先2分 |

| 面试必考点 | 五种上下文管理策略、MCP vs 目录识别、Backend接口设计 |

易错点提醒:

❌ 误认为“AI助手识别目录”就是简单的文件读取——错,它是一种完整的Agent架构思想

❌ 混淆MCP与目录识别的层次——MCP是协议,目录识别是思想

❌ 忽视预算管理——单纯的扩大窗口会导致性能下降

❌ 忘记“可解释性”——目录方式的最大优势之一是AI能告诉你“我用了哪些文件”

进阶预告:下一篇将深入解析预算感知型上下文管理(BACM)的强化学习实现,包括BACM-RL如何在预算持续收窄时保持1.6×的性能优势-46,敬请期待。