开篇引入

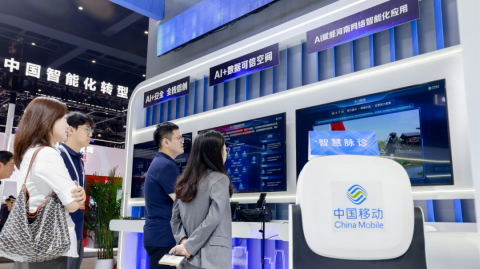

车展AI助手,正从展会现场的“新奇展品”蜕变为汽车智能化的“技术名片”。在2026年齐鲁春季车展上,山东数字文化集团研发的第三代数字人AI顾问依托大模型技术实现自然对话与情感交互双重升级,可精准提供展馆导航、品牌优惠实时查询、以旧换新政策解读、个性化车型推荐等一站式服务-32;在CES 2026上,赛轮思AI推出的Cerence xUI平台已将车载交互体验从“被动响应助手”升级为“主动感知、懂上下文的智能副驾”-2。这一技术跨越的背后,涉及大语言模型、智能体架构、端云混合部署等一系列技术选型。然而许多学习者面临的痛点是:听过AI助手这个词,却不理解背后的智能体与LLM如何协同工作;会调用语音SDK,却不懂多意图识别和上下文继承的底层逻辑;在面试中遇到“如何设计车载AI助手”的问题,往往答不出技术分层与工程权衡。本文将围绕车展AI助手的技术全貌,从概念定义到架构设计,从代码示例到面试考点,带你建立一套完整的知识链路。

本章要点:明确车展AI助手的技术定位与演进方向,建立“问题驱动”的学习思路。

一、痛点切入:传统语音助手为什么不够用了?

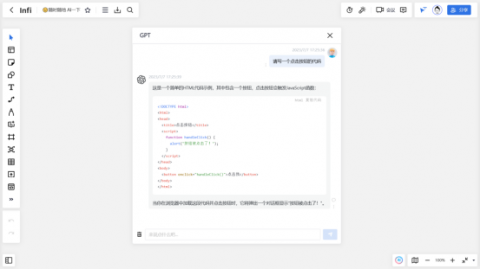

传统车载语音助手的实现,往往停留在“指令-响应”的线性模式。以下是一个典型的传统实现流程:

传统语音助手:关键词匹配模式 def traditional_voice_assistant(user_input): if "打开空调" in user_input: return "已为您打开空调" elif "导航" in user_input and "到" in user_input: dest = user_input.split("到")[-1] return f"正在导航到{dest}" elif "播放音乐" in user_input: return "正在播放音乐" else: return "我没有听懂,请再说一遍" 调用示例 print(traditional_voice_assistant("我感觉有点冷")) 输出:"我没有听懂,请再说一遍"

这段代码暴露了传统方案的三大缺陷:

1. 耦合度高:指令解析与业务逻辑杂糅在一起,新增一个功能就需要修改大量核心代码。

2. 扩展性差:用户说“我感觉有点冷”这种自然表达,系统完全无法理解——它不认识语义,只认识关键词。相比之下,博世在CES 2026展示的AI系统已能深度理解用户意图,驾驶员只需说出“我感觉有点冷”,车辆便会自动开启座椅加热功能并调高风扇温度-。

3. 无上下文记忆:用户先问“今天天气怎么样”,再问“那需要开空调吗”,传统助手无法建立两句话之间的逻辑关联。

正是这些痛点,催生了以大语言模型(Large Language Model, LLM)和智能体(Agent)为核心的新型车展AI助手架构。

二、核心概念:智能体 vs 大语言模型

2.1 大语言模型(LLM)

定义:大语言模型是一种基于海量文本数据训练、具备自然语言理解与生成能力的深度学习模型,其核心能力是“理解输入意图,生成合理输出”。

关键词拆解:

“大”:指参数量庞大(通常从数十亿到数千亿级别),模型能够记住丰富的语言模式和知识。

“语言模型” :本质是一个概率模型,根据上文预测下一个词出现的概率分布。

生活化类比:把LLM想象成一个读过万卷书的“超级学霸”。你问它任何问题,它都能凭借读过的内容给出看似合理的回答。但它并不知道自己“知道”什么,也不知道“不知道”什么——它只是在做文字接龙。

2.2 智能体(Agent)

定义:智能体是一个能够感知环境、自主决策并执行动作的AI系统。在车展场景中,智能体不仅包括语言理解能力,还集成了工具调用、多步推理、环境交互等能力。

它与LLM的关系:LLM是智能体的“大脑”,负责理解与规划;智能体是LLM的“完整身体”,拥有调用外部工具(如导航API、车辆控制接口)和执行动作的能力。

一句话总结:LLM负责“思考”,智能体负责“思考+行动”。

三、关联概念:端侧小语言模型 vs 云端大模型

3.1 小语言模型(SLM)

定义:SLM是参数规模较小(通常几亿到百亿级别)的语言模型,可在手机、车机等端侧设备本地运行,特点是低延迟、低功耗、高隐私。

3.2 两者的对比

| 维度 | 云端大模型(LLM) | 端侧小语言模型(SLM) |

|---|---|---|

| 部署位置 | 云端服务器 | 车机本地SoC |

| 响应延迟 | 较高(网络往返) | 极低(本地计算) |

| 算力依赖 | GPU集群 | 车规级AI芯片 |

| 隐私保护 | 数据需上传云端 | 数据留在车内 |

| 知识广度 | 海量通用知识 | 特定领域知识 |

运行机制示例:赛轮思CaLLM™ Edge端侧方案在SiMa.ai的高能效机器学习芯片上运行,凭借多模态能力实现性能提升与延迟降低的平衡,所有交互数据均在本地处理,避免了云端传输带来的隐私风险-2。其端云混合架构还支持断网情况下本地持续对话,云端和端侧同步数据实现上下文记忆-2。

四、概念关系与区别总结

下图清晰梳理了车展AI助手各核心概念之间的逻辑关系:

┌─────────────────────────────────────────────────────────────┐ │ 车展AI智能体(Agent) │ │ ┌─────────────┐ ┌─────────────┐ ┌─────────────────────┐ │ │ │ LLM(云端) │ │ SLM(端侧) │ │ 工具调用模块 │ │ │ │ 复杂推理 │ │ 快速响应 │ │ 导航/车控/联网 │ │ │ └─────────────┘ └─────────────┘ └─────────────────────┘ │ │ │ │ │ ┌─────────┴─────────┐ │ │ │ 多模态感知层 │ │ │ │ 语音/触摸/视觉 │ │ │ └───────────────────┘ │ └─────────────────────────────────────────────────────────────┘

一句话记忆:智能体是“大脑+手脚”,LLM是“大脑”,SLM是“本地轻量大脑”,三者协作共同驱动车展AI助手完成从“听懂”到“做好”的闭环。

五、代码示例:基于Function Calling的车展AI助手

以下是一个基于LLM Function Calling的车展智能助手核心示例,展示智能体如何通过工具调用来实现复杂的“看车-比价-推荐”流程:

车展AI智能体核心实现(基于LLM Function Calling) import json 1. 定义工具函数 TOOLS = [ { "type": "function", "function": { "name": "search_vehicle", "description": "根据预算和需求推荐车型", "parameters": { "type": "object", "properties": { "budget": {"type": "number", "description": "购车预算(万元)"}, "preference": {"type": "string", "enum": ["SUV", "轿车", "MPV"]} }, "required": ["budget"] } } }, { "type": "function", "function": { "name": "compare_models", "description": "对比两款车型的详细参数", "parameters": { "type": "object", "properties": { "model_a": {"type": "string"}, "model_b": {"type": "string"} }, "required": ["model_a", "model_b"] } } } ] 2. 工具函数实现 def search_vehicle(budget: float, preference: str = "SUV") -> dict: """模拟车型(实际应调用车辆数据库)""" return {"model": f"推荐车型-{preference}", "price": budget, "range_km": 650} def compare_models(model_a: str, model_b: str) -> dict: """模拟车型对比""" return { "model_a": {"name": model_a, "range": 650, "charging_time": 25}, "model_b": {"name": model_b, "range": 580, "charging_time": 30}, "verdict": f"{model_a} 续航更优" } 3. 智能体调度核心(模拟LLM决策后的工具调用) def agent_execute(tool_call): name = tool_call["function"]["name"] args = json.loads(tool_call["function"]["arguments"]) if name == "search_vehicle": return search_vehicle(args["budget"], args.get("preference", "SUV")) elif name == "compare_models": return compare_models(args["model_a"], args["model_b"]) else: return {"error": "Unknown tool"} 4. 模拟一次完整对话 user_query = "我想买一辆20万左右的SUV,帮我推荐几款,再对比一下续航" LLM解析意图 → 决策调用search_vehicle工具 result = agent_execute({ "function": { "name": "search_vehicle", "arguments": '{"budget": 20, "preference": "SUV"}' } }) print(f"推荐结果:{result}") 输出:推荐结果:{'model': '推荐车型-SUV', 'price': 20, 'range_km': 650}

关键代码标注:

TOOLS定义:这是智能体“知道”自己能用哪些工具的“说明书”,包含工具名称、描述和参数规范。agent_execute调度函数:模拟LLM完成意图识别后的工具路由层,是智能体架构的核心。架构优势:工具函数独立于LLM之外,新增“询价”“预约试驾”等功能时只需扩展TOOLS列表和对应实现,无需改动LLM调用逻辑。

六、底层原理:智能体调用的技术支撑

车展AI助手底层主要依赖以下核心技术:

1. Function Calling(函数调用) :这是LLM厂商提供的核心API能力。LLM在收到用户问题后,先判断是否需要调用外部工具,然后以结构化JSON格式输出“工具名称+参数”,而非直接输出自然语言回答。应用程序解析这个JSON后执行对应函数,再将结果返回给LLM生成最终回复。

2. 意图识别与槽位填充:系统需要将用户自然语言映射到结构化指令。以下为典型导航意图的JSON Schema定义:

{ "intent": "NAVIGATE_TO", "slots": { "destination": {"value": "北京西站", "type": "POI"}, "waypoint": {"value": "中关村", "type": "POI", "optional": true} } }

这种结构支持动态槽位填充与约束校验,type字段驱动NLU实体识别策略-16。

3. 端云混合推理:简单意图(如“调高空调温度”)由端侧SLM直接处理,保证毫秒级响应;复杂意图(如“找一家评分高、有充电桩、停车方便的中餐厅”)则由云端LLM进行深度推理。

4. RAG(检索增强生成) :当用户询问某款具体车型的参数时,智能体需要先从车辆知识库中检索相关信息,再交由LLM生成答案,避免LLM“编造”不存在的参数。

七、高频面试题与参考答案

Q1:车展AI智能体与传统语音助手的核心区别是什么?

参考答案:核心区别在于三点:一是架构差异,传统助手采用关键词匹配的规则引擎,智能体基于LLM进行语义理解;二是能力边界,传统助手只能执行预定义指令,智能体通过Function Calling可调用任意外部工具;三是交互范式,传统助手是被